[自主科技]

目前AI訓練平行運算仍非常依賴GPU,全球最大GPU是美國NVidia,另一家主要廠商為,美國政府要求AMD和Nvidia,停止對華出口尖端AI晶片。

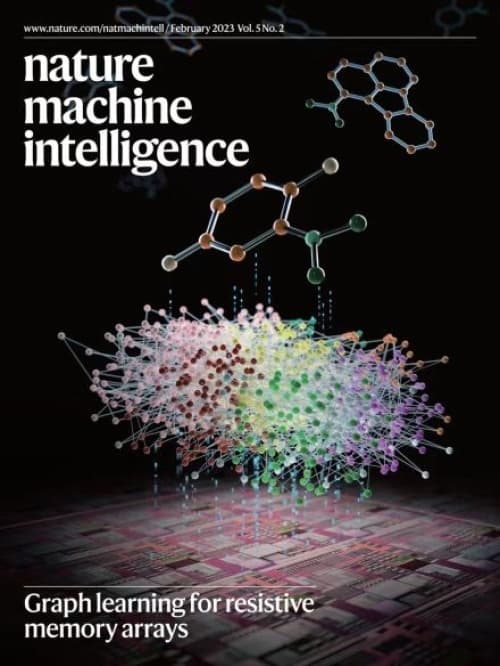

中國一直發展半導體技術,提供更大AI算力。本港亦有學者研究新一代以存儲和運算合二為一的技術加速AI。香港大學和中國科學院團隊以新半導體應用到AI論文,登上《自然.機器智能》封面。中美磨擦亦有可能加快國內研究新半導體,繞過美國對AI算力的施限。

存算一體加速AI

AI對算力需求極大,CPU和GPU處理器的算力,亦逐漸不敷應用,半導體進入3納米,逐漸達物理極限,即使沒中美角力出現,亦須研發新運算範式,才能應付未來算力,今次研究證明本港在半導體基礎研究實力。

阻變憶阻器(RRAM,Resistive RAM,或者稱為電阻式記憶體)已廣泛被認為可顯著提升AI計算效率。RRAM利用名為「憶阻器」(memristor)元件的新材料,以獨特的阻變機制,例如電化學反應實現電信號歷史調節的可變電阻,被統稱為「有記憶電阻」或者Memristor,最小能縮至2×2納米,甚至三維堆疊加大密度。

憶阻器讓一定的電流安全通過,斷電後還可「記住」器件之前的電阻值,最初被當作記憶體來研究,後來才發現AI運算潛力更大。原因是憶阻器存儲數據之餘,更可「原地」運算。

突破電腦架構限制

目前電腦以Von Neumann架構為主流,存儲和運算是分開執行。新一代「存算合一」(In-Memory Computing),開發兼具運算與儲存功能的記憶體元件。憶阻器離子動力學可在原子尺度,模擬人類神經元與突觸特性,以簡單電路定律執行平行運算,有望實現具生物大腦級的運算系統,又被稱為「類腦運算」(Neuromorphic computing)。

AI運算主要是對數據進行矩陣運算,主要是「乘和加」。CMOS晶片不擅長大規模矩陣運算的乘加,憶阻器本身就是記憶體;運算時無需將數據從記憶體搬至處理器,直接原地以歐姆定律運算,存算一體後,可小功耗實現大算力。

軟硬件合一加速

港大和中科院的團隊以RRAM,加速新一代深度學習「圖神經網路」(Graph Neural Network),處理複雜的非結構化資料,開發出「儲池計算」(Reservoir Computing),實現了圖結構化數據分類技術的「回聲狀態圖網絡」(ESGNN)。

研究團隊利用了RRAM構建大規模隨機電阻陣列,降低運算成本並具擴充能力。ESGNN配合軟體,運用隨機電阻陣列帶來物理隨機投影,以內存運算的方式完成圖嵌入過程,降低圖神經網絡運算成本,比傳統數碼硬體提升2.16、35.42和40.37倍能效,研究證明了RRAM陣列在建立邊緣圖學習系統的應用潛力。

國內有不少憶阻材料專家,包括復旦大學周鵬、清華大學吳華強、北京大學楊玉超等。吳華強曾在《自然》發表論文,以憶阻器執行CNN深度學習性能超越GPU;並成立「新憶科技」商業化RRAM應用。

論文由中國科學院微電子研究所微電子器件與集成技術重點實驗室尚大山與港大電子工程系王中銳合作,RRAM只是「存算一體」其中一種晶片:其他包括相變化記憶體(Phase Change Memory, PCM)、磁阻式記憶體(Magnetoresistive RAM, MRAM)與鐵電記憶體(ferroelectric memory),但RRAM較為成熟,更有希望成為新一代運算架構技術。